Функции на активиране в невронни мрежи

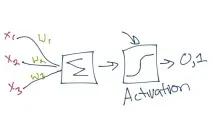

За да определим конвенциите, представяме следния невронен модел:

Функция за активиране (функция за активиране, функция за възбуждане) е функция, която изчислява изходния сигнал на изкуствен неврон. Той приема като аргумент сигнала, получен на изхода на входния суматор. Най-често се използват следните функции за активиране.

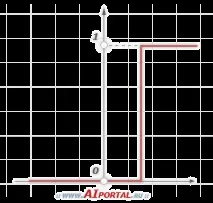

1. Функция за единичен скок или твърд праг

Проста частично линейна функция. Ако входната стойност е по-малка от праговата стойност, тогава стойността на функцията за активиране е равна на минимално допустимата, в противен случай - максимално допустимата.

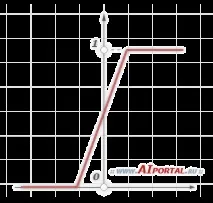

2. Линеен праг или хистерезис

Проста частично линейна функция. Той има два линейни участъка, където функцията на активиране е идентично равна на минимално и максимално допустими стойности, и има участък, на който функцията е строго монотонно нарастваща.

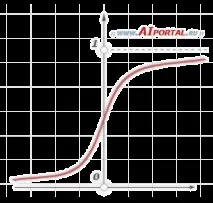

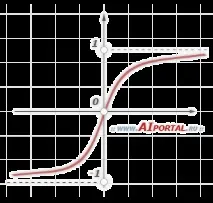

3. Сигмоидна функция или сигмоид

Монотонно нарастваща навсякъде диференцируема -образна нелинейна функция с насищане. Sigmoid ви позволява да усилвате слабите сигнали и да не се насищате от силни сигнали. Гросберг (1973) установи, че такава нелинейна активираща функция решава неговата дилема за насищане с шум.

Пример за сигмоидална функция на активиране елогистичната функция, дадена от следния израз:

където е параметърът на наклона на сигмоидалната функция на активиране. Чрез промяна на този параметър е възможно да се конструират функции с различна стръмност.

Друг пример за сигмоидална функция на активиране ехиперболичният тангенс, даден от следния израз:

където е също параметър, който влияе на наклона на сигмоидната функция.

В заключение отбелязваме, че функциите за активиране като единичен скок и линеен праг са много редки и като правило се използват в примери за обучение. В практическите задачи почти винаги се използва сигмоидалната функция за активиране.