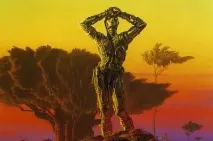

Трите закона на роботиката Могат ли да ни защитят?

Изминаха 50 години, откакто Айзък Азимов излезе с прочутите си Три закона на роботиката, набор от правила, които всеки уважаващ себе си робот трябва да следва. Въпреки че първоначално е бил само литературен похват, Трите закона се превръщат в оригиналната рецепта за избягване на „роботокалипсиса“. За щастие има експерти, които проверяват със сигурност дали гаранциите на Азимов са издържали проверката на времето. За съжаление всички те казват „не“.

Нека започнем с тези три закона:

- Един робот не може да нарани човек или с бездействието си да позволи човек да бъде наранен.

- Роботът трябва да се подчинява на всички заповеди, дадени от човек, освен ако тези заповеди не противоречат на Първия закон.

- Роботът трябва да се грижи за своята безопасност, доколкото това не противоречи на Първия и Втория закон.

Азимов по-късно добави четвърти или нулев закон, който предшества останалите по отношение на предимство:

0. Един робот не може да навреди на човек, освен ако не може да докаже, че в крайна сметка ще бъде от полза за цялото човечество.

Във фантастичната вселена на Азимов почти всички роботи трябваше да следват тези закони. Това не бяха просто предложения или насоки - законите бяха вградени в софтуера. Освен това тези правила не могат да бъдат заобикаляни, пренаписвани или преработвани.

Както показа самият Азимов, несъвършенствата, вратичките и неяснотите в тези закони често водят до странно и нелогично поведение на роботите. Законите бяха твърде неясни и често не успяваха да дефинират и разграничат „хора“ от „роботи“. В допълнение, роботите биха могли несъзнателно да нарушат законите, ако не разполагат с пълна информация. Също така прекалено умен роботили изкуственият интелект трябваше да бъде под натиск да не препрограмира ядрото си.

Годината е 2014 и много ежедневни неща от нашия живот могат да се сторят направо фантастика на писателите на научна фантастика от миналия век. Много хора смятат, че законите на Азимов трябваше да останат като литературен прием. Но самият Азимов отбеляза през 1981 г., че неговите закони могат да работят. В статия в Compute! той заяви следното:

„Когато някой ме попита какво би било, ако моите три закона на роботиката действително се използват за определяне на поведението на роботите, отговорът вече е там. Разбира се, при условие че роботите са достатъчно гъвкави и многофункционални, за да имат различно поведение. Отговарям: да, трите закона са единственият начин, по който хората могат да взаимодействат с роботи - или с нещо друго.

Близо тридесет години по-късно се доближихме до реалността, в която ще имаме роботи — или, за да бъдем по-точни, изкуственият интелект, който ги контролира — които са достатъчно гъвкави и гъвкави за различни начини на действие. Остава само въпрос на време машината да надмине човека във всяко отношение, от физическата сила до силата на въображението.

Страшно е, че практически няма място за грешка. Ако изкуственият суперинтелект е зле програмиран или безразличен към хората, това ще доведе до катастрофа. Трябва да гарантираме, че изкуственият интелект е безопасен, ако искаме да преживеем появата му.

Бъдещето на Азимов?

Разговорът с Херцел и Хелм започна с това какво не е сгрешил Азимов в предсказването на бъдещето, а какво е сгрешил.

„Мисля, че типът роботи, който Азимов си представи, ще стане възможен в не много далечното бъдеще“, отговаря Херцел. - Все пак в по-голямата си частизмислени светове, писателят си представя хуманоидните роботи като върхът на роботиката и инженерството на изкуствения интелект. Малко вероятно е. Съвсем скоро, след достигане на статута на роботите на Азимов, ще стане достъпно и създаването на изкуствен суперинтелект и суперроботи.

Така типичният бъдещ свят в разказите за роботите на Азимов, според Херцел, ще бъде подобен на този, в който живеем днес, но с интелигентни роботи, които се разхождат по улиците.

„Едва ли ще се случи, а ако се случи, няма да е за дълго.

За Helm роботите са напълно различни.

„Основният въпрос, който според мен ще бъде най-важен за човечеството, остава не моралното регулиране на огромен брой полусъзнателни хуманоиди, а евентуалното развитие на напреднали форми на изкуствен интелект (във всяко тяло). Това развитие на свръхинтелигентност е филтърът, през който човечеството в крайна сметка трябва да премине. Ето защо разработването на стратегия за сигурност за този преход е толкова важно. Струва ми се напълно странно, че роботите, андроидите или „емулациите“ ще съществуват десет години или малко повече, докато човечеството не се изправи пред истинския проблем с разработването на машинна етика за суперинтелигентност.

Добро начало?

Като се има предвид, че Трите закона на роботиката на Азимов са първият искрен опит за решаване на много сериозен проблем - проблемът за безопасното поведение на машините с изкуствен суперинтелект - струва си да потърсите тези точки, в които законите все още могат да бъдат ефективни (или поне вдъхновяващи).

„Честно казано, не намирам никакво вдъхновение в тези три закона на роботиката“, казва Хелм. - Същността на етиката на машините е, че те не го правятотговарят на основата на машинната етика. Може би трите закона на роботиката са широко известни, но всъщност е безполезно да се използват като основа за програмиране.

„По някаква причина една система от добра етика - така наречената деонтология - се е превърнала в ненадеждна основа за етика. Има редица философи, които се опитват да коригират проблемите на деонтологията, но в по-голямата си част те си остават същите хора, които търсят "интелигентен дизайн" и "божествена намеса". Никой не ги приема на сериозно."

Недостатъците на трите закона на роботиката на Азимов са следните:

- Състезателен по същество

- Въз основа на остаряла етична теория (деонтология)

- Те дори не работят в научната фантастика

„Целта на трите закона беше да ги нарушим по интересен начин; затова историите с тяхно участие са особено забавни. Затова трите закона могат да останат само морализаторски пример какво не трябва да се прави. Ако ги вземете за основа, в тях неизбежно ще има вратички.

Херцел смята, че в действителност тези закони няма да работят, тъй като термините с тяхно участие са двусмислени и остават обект на тълкуване, което означава, че са изключително зависими от тези, които правят преводи.

Предразсъдъци срещу роботите?

Друг аспект (и потенциален недостатък) на трите закона в очевидния шовинизъм е предположението, че роботите трябва да останат, въпреки превъзходната си сила, подчинени на човека, човешките нужди и приоритети.

„Обществото на бъдещето на Азимов се състои изцяло от шовинисти: хората имат много повече права от роботите. Трите закона на роботиката са създадени, за да поддържат точно такъв социален ред.

Хелм гледа на този проблем малко по-различно, като твърди, че акоще се окажем в такава ситуация - това само по себе си ще е доказателство, че сме прекалили.

„Мисля, че би било неразумно да се проектира система с изкуствен интелект или самоосъзнат робот. И за разлика от филмите или книгите, в които създателите на изкуствения интелект "случайно" стигат до интелигентни машини, не вярвам, че това може да се случи в реалния живот. Това ще изисква твърде много усилия и знания. И повечето разработчици на AI са етични хора, така че ще избягват да създават това, което философите наричат „морално значими същества“. Особено когато могат лесно да създадат усъвършенствана машина, която няма етични наклонности."

Хелм не се притеснява от необходимостта да се разработят асиметрични закони, управляващи значението на роботите над хората, като твърди (и се надява), че бъдещите създатели на AI ще разчитат на някои етични ограничения.

„Мисля, че хората са направени от атоми, така че на теория един инженер може да създаде синтетична форма на живот или робот с морално значение. Бих искал да мисля, че никой няма да го направи. Мисля, че повечето хора също го правят. Но неизбежно ще има някой глупак, който жадува за пионерска слава, дори това да е неетично и глупаво.

Три закона на роботиката 2.0?

Предвид очевидните недостатъци на трите закона на роботиката на Азимов, io9 зададе въпроса: могат ли те да бъдат коригирани или подобрени? Всъщност много писатели на научна фантастика са опитвали това отново и отново, правейки корекции през годините.

Не, казва Хелм. „Няма кръпки за трите закона.“

Освен противоречив характер, законите са и състезателни по природа.

„Аз съм привърженик на подходите на машинатаетика, която е по-кооперативна, по-последователна и нормативна и следователно може да се възстанови от недоразумения или да коригира грешното програмиране.

Херцел повтаря твърденията на Хелм.

„Определянето на набор от етични принципи като сърцевина на машинната етика ще бъде безнадеждно, ако машината се основава на гъвкав общ изкуствен интелект. Ако е замислен като интуитивен, гъвкав, адаптивен или етичен - в този контекст етичните предписания ще бъдат полезни за системата само като грубо ръководство за прилагане на собствената й етична интуиция. Но в този случай заповедите няма да станат основа на етичната система, а само аспект. Това се вижда от примера на хората - етичните принципи, които научаваме, работят, но не като насоки, те само подтикват нашата интуиция и етични инстинкти. Ние сме практически независими от етичните принципи.“

Как да създадем сигурен изкуствен интелект?

Като се има предвид неадекватността на правния подход, можете да попитате Herzel и Helm за съвременните подходи към проблема със „сигурния AI“.

„Много малко изследователи на общото разузнаване на ИИ вярват, че е възможно да се създаде система, която е напълно сигурна“, казва Горцел. „Но това не притеснява най-много, защото нищо не е гарантирано в този живот.“

Херцел вярва, че след като създадем система с изкуствен общ интелект или неин ембрион, ще можем да провеждаме проучвания и експерименти, които ще ни разкажат за етиката на ИИ много повече, отколкото знаем.

„Надяваме се, че по този начин можем да формулираме добри теории за етиката на изкуствения интелект, което ще ни позволи да се задълбочим в тази тема. Но сега да теоретизирамеетиката на изкуствения интелект е доста трудна, защото ние не просто имаме добри теории, ние изобщо нямаме никакви теории.“

„И за хората, които са гледали твърде много терминатори, процесът на създаване на изкуствен интелект може да бъде смущаващ, тъй като те пропускат думата „примитивен“ в този контекст. Но най-драстичните промени се случиха по този начин.

„Когато група умни пещерни хора изобретиха езика, те не изчакаха да разработят солидна формална теория за езика, която може да помогне да се предвидят бъдещи промени, предизвикани от езика в обществото.“

Преди да разгледаме развитието на следващите „три закона“ като технически проблем, трябва да се направят много изследвания. И в това Хелм и Херцел са съгласни.

„Моят колега от MIRI Luc Muellhauser обобщи нашите разсъждения по следния начин. Той каза, че проблемите често се преместват от царството на философията към математиката и след това към инженерството. Философията често задава правилните въпроси, но по най-непрактичния начин. Никой не може да каже със сигурност дали има напредък в разрешаването на проблема. Ако можем да преформулираме важните философски проблеми на ума, идентификацията и стойността в точни формули, с които математиката може да се справи, тогава може да се изгради някакъв модел. Един ден ще стигне до инженерството.“

Хелм смята този проблем за труден за науката и философията, но напредъкът е възможен.

„Скептичен съм, че философията може да разреши въпрос, който се бори повече от 3000 години. Но също така не можем да вземем и да започнем да съставяме математически модели на въпроси, които не съществуват технически. Все още се нуждаем от много теоретични и дори практически разработки.